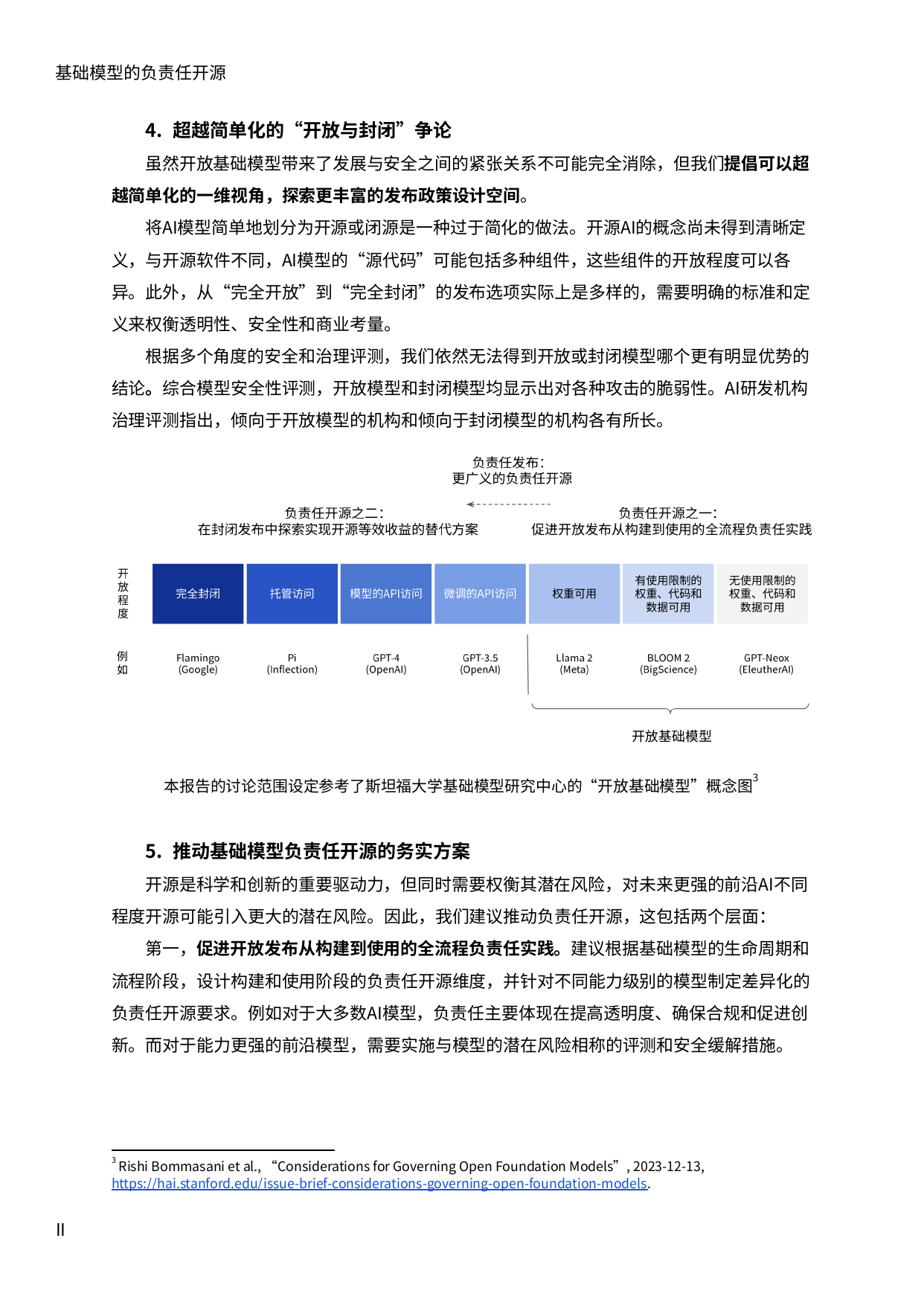

执行摘要执行摘要1.开源基础模型已成为创新的重要驱动力之一根据斯坦福大学《2024年AI指数报告》1,2023年全球总共发布了149个基础模型,比2022年发布的数量翻了一倍还多,而且更高比例是开源的。在这些新发布的模型中,有65.7%是开源的,相比之下,2022年只有44.4%,2021年只有33.3%的模型是开源的。根据全球开源社区HuggingFace的调研2,Llama1和Llama2现在已经衍生出了3万个新模型。多位专家预计,即将推出的Llama3400B将会是“首个GPT-4级别的开源模型”。2.如何治理开源AI已成为短期内重要的未解决议题之一本报告从安全治理的角度探讨开源AI的政策和实践。在制定相关政策时,各国需要综合考虑促进创新生态、技术的安全性与可控性、隐私保护、知识产权、伦理与责任、国际合作与标准制定、市场竞争环境、教育与公众参与等多个方面。这些维度与各国的战略考虑及监管取向相结合,共同构成了开源AI的治理政策框架。全球范围内,许多国家和地区,包括欧盟、美国、英国、法国、中国以及其他全球南方国家,都在积极制定AI相关政策,开源AI也成为多项政策探索的核心。尽管这些政策旨在平衡技术发展与安全需求,但在监管取向和具体条款的设计上存在显著差异,这部分原因是由于政策制定过程中缺乏关于风险、收益及潜在影响的严谨证据。3.前沿AI开源的主要争论领先的基础模型研发机构近年决定开源其模型或限制对其模型的访问,引发了关于是否以及如何开放能力日益增强的基础模型的争论。我们识别了两种主要立场:一方是审慎开放的倡导者,他们担心前沿AI开源成为潜在不安全技术“不可逆转的扩散”,并主张在确保安全的基础上逐步推进开放...

发表评论取消回复